简介说明

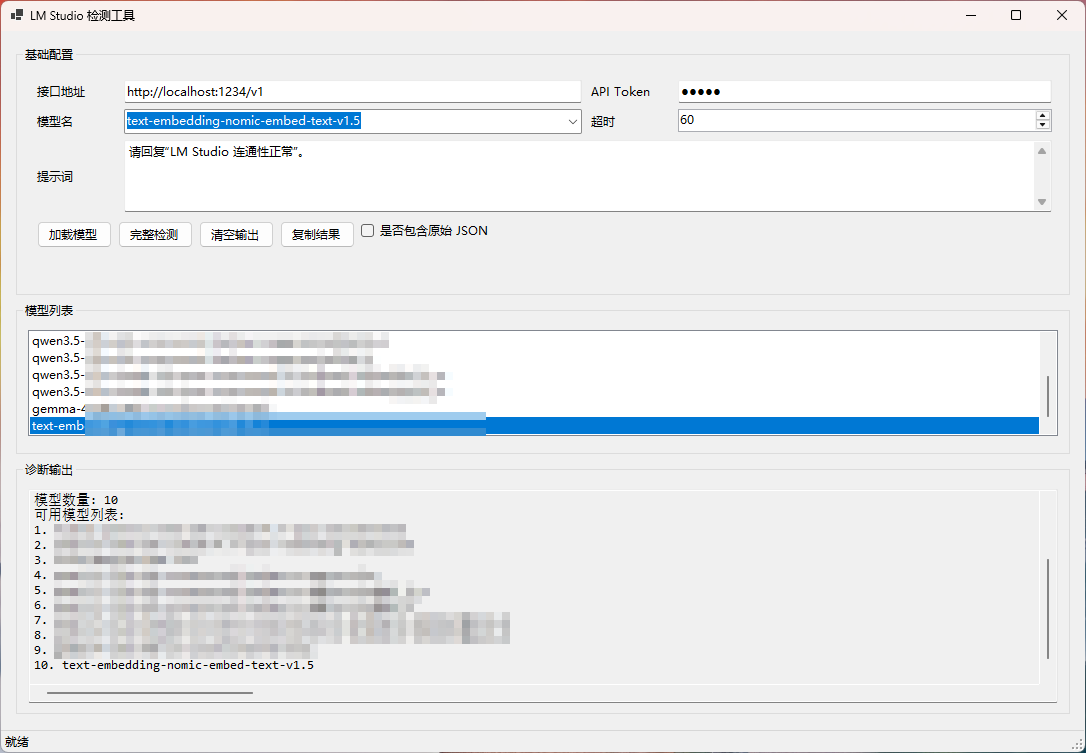

LM Studio API 对接测试诊断程序 API通讯检测工具

这个小工具专门用于排查 到底是 LM Studio 配置问题,还是你的 API 应用接入问题。

现在仓库里有两个版本:

LmStudioProbe:控制台版

LmStudioProbe.Gui:Windows 桌面界面版

它会依次检测:

- `GET /v1/models` - `GET /api/v1/models` - `POST /v1/chat/completions`

如果 `OpenAI 兼容接口` 正常,但你的业务程序仍报错,通常就说明更像是你的应用参数、模型名或请求体有问题。

1. 先准备 LM Studio

根据 LM Studio 官方文档:

在 `Developer` 页面打开 `Start server`

默认地址是 `http://localhost:1234`

OpenAI 兼容接口的 `base URL` 要写成 `http://localhost:1234/v1`

如果开启了 `Require Authentication`,请求必须带 `Authorization: Bearer `

官方文档:

https://lmstudio.ai/docs/developer/core/server

https://lmstudio.ai/docs/developer/openai-compat

https://lmstudio.ai/docs/developer/core/authentication

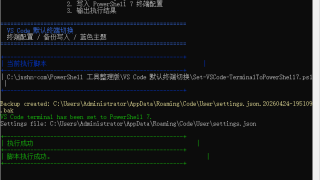

2. 安装 .NET SDK

本程序是 `net8.0` 控制台项目,需要先安装 .NET 8 SDK:

https://dotnet.microsoft.com/download/dotnet/8.0

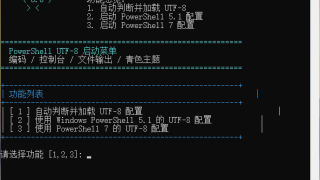

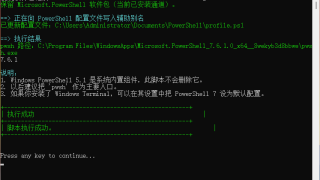

3. 运行方式

在当前目录执行:

```powershell

dotnet run --project .\LmStudioProbe\LmStudioProbe.csproj

```

运行图形界面版:

```powershell

dotnet run --project .\LmStudioProbe.Gui\LmStudioProbe.Gui.csproj

```

只检测并列出模型名:

```powershell

dotnet run --project .\LmStudioProbe\LmStudioProbe.csproj -- --list-models

```

如果你还想看 `/v1/models` 的原始 JSON:

```powershell

dotnet run --project .\LmStudioProbe\LmStudioProbe.csproj -- --list-models --raw-models

```

指定模型:

```powershell

dotnet run --project .\LmStudioProbe\LmStudioProbe.csproj -- --model qwen/qwen3-14b

```

自定义地址和 Token:

```powershell

dotnet run --project .\LmStudioProbe\LmStudioProbe.csproj -- `

--base-url http://localhost:1234/v1 `

--api-key 你的token `

--model 你的精确模型标识

```

4. 参数说明

`--base-url`:默认 `http://localhost:1234/v1`

`--api-key`:可选。如果 LM Studio 开启认证,就必须提供

`--model`:可选。建议填 `GET /v1/models` 返回的精确 `id`

`--prompt`:可选,自定义测试问题

`--timeout`:可选,默认 `60`

`--list-models`:只请求 `/v1/models`,列出当前可用模型名

`--raw-models`:配合 `--list-models` 使用,额外输出原始 JSON

## 5. 常见结论怎么理解

- `两个 models 接口都连不上`

- 通常是 LM Studio 没启动,或端口不对

- `native /api/v1/models 能通,但 /v1/models 不通`

- 通常是 OpenAI 兼容接口路径写错

- `401 / 403`

- 通常是开启了认证,但没带 token 或 token 错了

- `models 能列出来,但 chat/completions 400`

- 通常是模型名不对,或者请求体字段不兼容

- `全部成功,但你的业务程序仍失败`

- 更像是你业务程序自己的接入代码有问题

6. 一个最容易踩的坑

模型名必须和 `/v1/models` 返回的 `id` 完全一致。

也就是说,LM Studio 里“检测模型名字”的接口本身就是:

```http

GET http://localhost:1234/v1/models

```

如果开启了认证,请带上:

```http

Authorization: Bearer

```

比如你的模型可能在 LM Studio 里实际叫:

```text

qwen/qwen3-14b

```

或者:

```text

Qwen/Qwen3-14B-GGUF

```

而不是你自己手写一个:

```text

qwen3.5

```

很多“模型不存在”或 `400` 报错,都是这里导致的。

使用方式

解压后yunx

LmStudioProbe.Gui.exe

图片预览

下载地址

https://pan.baidu.com/s/1q4nUHvhgSXjRFpzfJitg2w?pwd=dv9e 提取码: dv9e

评论抢沙发